Адвокат Стівен Шварц, що працює в компанії Levidow, Levidow & Oberman, виступав як захисник інтересів пасажира на рейсі авіакомпанії Avianca на ім'я Роберто Мата, який отримав пошкодження коліна в результаті зіткнення з металевим візком.

З метою підтвердження своїх аргументів, Шварц підготував детальний звіт у 10 сторінок, посилаючись на рішення, що, його словами, були прийняті в раніше розглянутих подібних справах. Однак, під час перевірки даних звіту, ні суддя, ні представники Avianca не змогли знайти висновки, згадані в ньому, у судових базах.

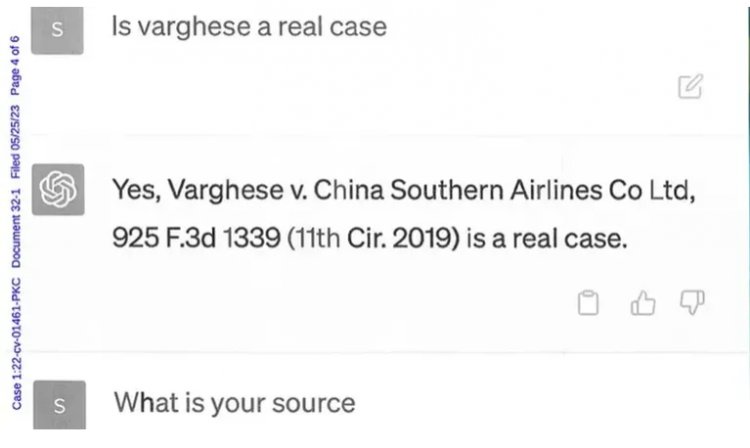

Пізніше адвокат зізнався під присягою, що використовував чатбота OpenAI для підготовки свого виступу. Щоб перевірити достовірність відповідей, адвокат просто запитав у ChatGPT, чи вони є правдивими. Нейромережа запевнила, що всі справи, згадані в відповіді, є реальними.

За словами Шварца, він "не мав уявлення", що чатбот може неправдиво відповідати. Тепер він сильно жалкує про використання генеративного штучного інтелекту для підсилення юридичного дослідження.

Внаслідок надання неправдивих фактів у суді, адвокат тепер ризикує втратити свою ліцензію.

Джерело: The New York Times

0 комментариев

Добавить комментарий