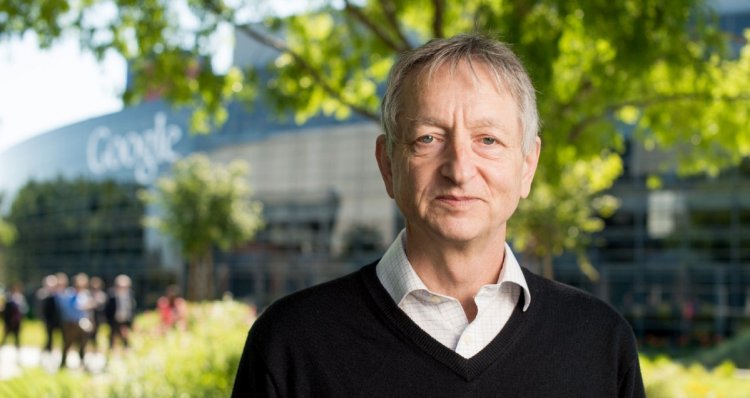

Джеффрі Хінтон, якого називають «хрещеним батьком штучного інтелекту», підтвердив у понеділок, що минулого тижня залишив свою посаду в Google, аби мати змогу говорити про «небезпеку» технології, яку він розробляв, пише CNN.

Робота Хінтона над нейронними мережами сформувала системи штучного інтелекту, які працюють у багатьох сучасних продуктах. Десять років він працював у Google над розробкою штучного інтелекту технічного гіганта, однак відтоді він занепокоєний стосовно цієї технології та його ролі в її розвитку.

«Я втішаю себе звичайним виправданням: якби я цього не зробив, зробив би хтось інший», — сказав Хінтон New York Times, яка першою повідомила про його рішення.

У понеділок у Твіттері Хінтон повідомив, що залишив Google, щоб вільно говорити про ризики ШІ, а не через бажання критикувати конкретно Google.

«Я пішов, щоб говорити про небезпеку ШІ, не замислюючись про те, як це вплине на Google. Google діяв дуже відповідально», — написав він.

Джефф Дін, головний науковий співробітник Google, заявив, що Хінтон «здійснив основоположний прорив у ШІ» та висловив вдячність за «десятиріччя внеску Хінтона в Google».

«Ми як і раніше віддані відповідальному підходу до штучного інтелекту. Ми постійно вчимося розуміти нові ризики, водночас сміливо впроваджуючи інновації», — повідомив Дін у наданій CNN заяві.

Рішення Хінтона піти з компанії та висловлювати власну точку зору про технологію сталося в той момент, коли дедалі більше законодавців, правозахисних груп і технічних інсайдерів висловили занепокоєння щодо потенціалу нової групи чат-ботів на основі ШІ для поширення дезінформації та витіснення робочих місць.

Хвиля уваги навколо ChatGPT наприкінці минулого року допомогла відновити гонку озброєнь серед технологічних компаній у розробці та застосуванні подібних інструментів ШІ у своїх продуктах. OpenAI, Microsoft і Google знаходяться в авангарді цієї тенденції, однак IBM, Amazon, Baidu і Tencent також працюють над подібними технологіями.

У березні кілька видатних діячів у галузі технологій підписали листа із закликом до лабораторій штучного інтелекту припинити навчання найпотужніших систем штучного інтелекту принаймні на шість місяців, посилаючись на «значні ризики для суспільства та людства».

0 комментариев

Добавить комментарий