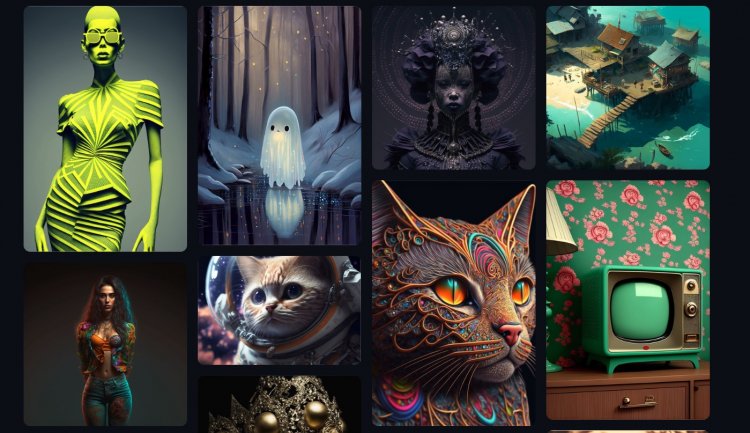

Компанія Midjourney закрила безкоштовний доступ до своєї однойменної нейромережі, яка дозволяє генерувати зображення за текстовим описом. Сталося це після того, як користувачі почали активно використовувати нейромережу для створення дипфейків за участю знаменитих особистостей.

Засновник і виконавчий директор Midjourney Девід Хольц (David Holz) в офіційному каналі Discord повідомив, що компанія закриває програму безкоштовного пробного періоду «через надзвичайний попит, а також зловживання у його використанні з боку користувачів». За словами Хольця,

нові правила безпеки використання нейромережі Midjourney виявилися «недостатніми» для запобігання випадкам неправильного використання ШІ-генератора зображень під час пробного періоду. Відтепер користувачі Midjourney повинні будуть платити $10 на місяць за можливість користуватися технологією.

Як пише видання The Washington Post, Midjourney останнім часом опинилася у центрі небажаної уваги. Користувачі, використовуючи вказану нейромережу, почали створювати фейкові зображення з арештом колишнього президента США Дональда Трампа, а також зображення Папи римського Франциска, який розгулює в модному пуховику. Хоча вказані зображення швидко викрили як фейки, зловмисники можуть використовувати генеративні нейромережі на зразок Midjourney, DALL-E від OpenAI та аналогічні для поширення дезінформації в Мережі.

Midjourney визнала, що правила використання ШІ-алгоритмів для створення зображень потребують доопрацювань.

У 2022 році Хольц заборонив використовувати Midjourney для створення дипфейків із китайським лідером Сі Цзіньпінем. Він пояснив це тим, що доступ на китайський ринок для компанії важливіший за можливості для користувачів створювати сатиричний контент. Цього четверга Хольц у розмові з користувачами в Discord поскаржився, що формування політики щодо створення ШІ-контенту за допомогою Midjourney ще більше ускладнилося тим фактом, що ШІ тепер здатний створювати ще більш реалістичні зображення. Незважаючи на це, компанія продовжить удосконалювати модерацію ШІ-контенту та виявляти випадки зловживання у його створенні, додав він.

Деякі розробники нейромереж для генерації зображень вже запровадили суворіші правила, пов'язані з їх використанням. Наприклад, OpenAI заборонила створювати будь-які зображення, які будь-яким чином були б пов'язані з поточними політичними подіями, політиками та теоріями змов. Вона також заборонила контент, пов'язаний із ненавистю, насильством та сексом. Втім, інші поки що дотримуються вільніших правил. Stability AI не дозволяє нейромережі Stable Diffusion копіювати стилі або створювати так звані "небезпечні для роботи" зображення. Проте загалом компанія не диктує користувачам, які зображення можна чи не можна створювати.

0 комментариев

Добавить комментарий