Instagram вживає нових заходів, щоб обмежити поширення зображень оголеного тіла на платформі. Це роблять насамперед для запобігання шахрайству та захисту підлітків.

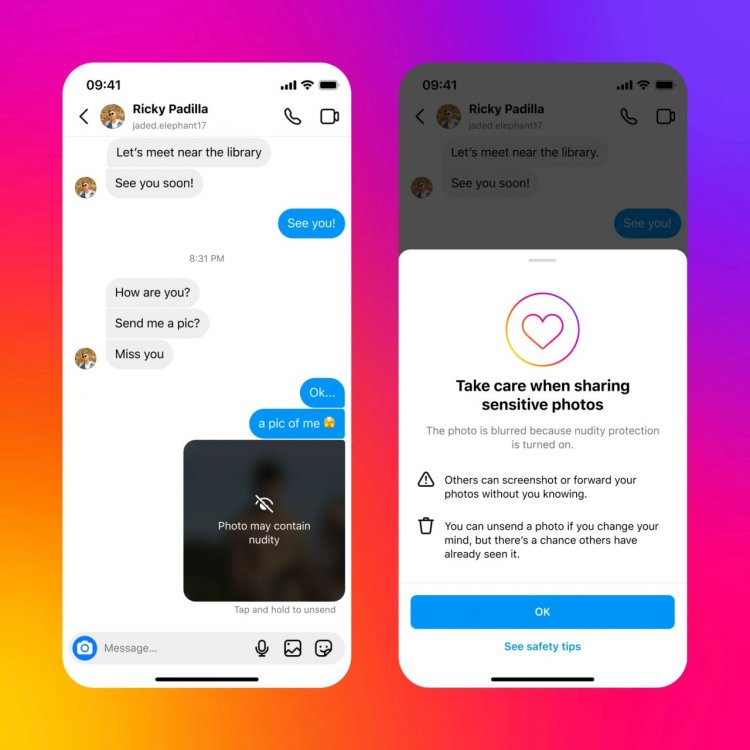

Шахраї можуть використовувати особисті повідомлення в Instagram, щоб ділитися ню-фотографіями або просити надіслати їм інтимні зображення. Щоб запобігти цьому, Instagram почне тестувати нову функцію. Тепер коли хтось отримуватиме зображення оголеного тіла, воно автоматично розмиватиметься, а зверху з'являтиметься попередження. Це дозволить користувачам вибирати, чи дійсно вони бажають це побачити.

Розмиття таких зображень буде включено за умовчанням для підлітків віком до 18 років у всьому світі. Дорослим користувачам також пропонуватиметься його увімкнути.

«Ми скоро почнемо тестувати нашу нову функцію захисту щодо оголеного тіла в DM в Instagram, яка розмиває зображення, що містять оголене тіло, і спонукати людей добре подумати, перш ніж надсилати зображення оголеного тіла. Ця функція призначена не тільки для того, щоб захистити людей від небажаного зображення оголеного тіла в їхньому DM, але й для захисту їх від шахраїв, які можуть відправляти зображення оголеного тіла, щоб обманом змусити людей відправити свої власні зображення у відповідь», - повідомляє Instagram. у своєму блозі.

Коли ця установка увімкнена, користувачі також будуть бачити пропозицію бути обережними, надсилаючи інтимні фотографії.

«При надсиланні або отриманні цих зображень люди отримуватимуть поради щодо потенційних ризиків, розроблені під керівництвом експертів. Ці поради включають нагадування про те, що люди можуть робити скріншоти або пересилати зображення без вашого відома, що ваші стосунки з людиною можуть змінитися в майбутньому, і що вам слід уважно переглядати профілі, щоб ці люди не були не тими, за кого видають себе». , - Зазначає компанія.

У цих ситуаціях користувачам також буде пропонуватися звернутися до Центру безпеки Meta або лінії підтримки (StopNCII.org для повнолітніх і Take It Down для тих, кому не виповнилося 18 років).

Що стосується механізму роботи нової функції, Meta кажуть, що захист від зображень оголених тіл використовує машинне навчання. Зображення будуть аналізуватися на самому пристрої, тому Meta не матиме доступу до цих фото.

0 комментариев

Добавить комментарий