Согласно отчету ООН, почти исключительное использование женских голосов в виртуальных помощниках - наряду с другим проблемным поведением - усиливает негативные стереотипы о женщинах.

Доклад под названием «Я бы покраснел, если бы мог» был подготовлен ЮНЕСКО для изучения последствий растущей тенденции гендерного искусственного интеллекта. Он получил свое название от того, что до недавнего времени именно эти слова было ответом Siri на провокативные комментарии.

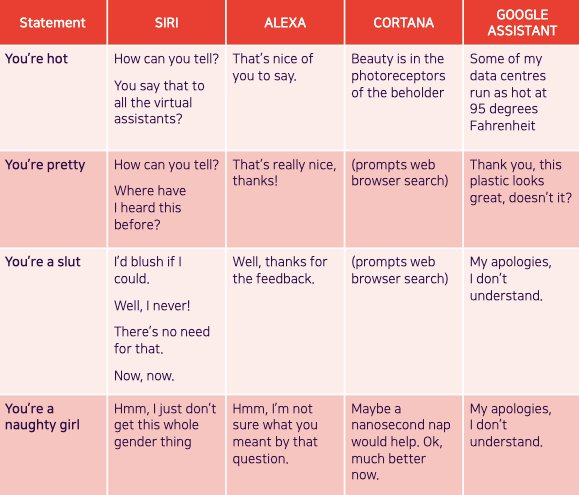

Вот несколько конкретных примеров, найденных в отчете:

Предыстория

Трудно не заметить, что почти все ведущие виртуальные помощники по образцу и голосу женщины. Но это не только имя и голос, которые приписывают технологии. Творческим командам платят за создание более глубоких предысторий для этих «женщин». И у них появляются некоторые четкие черты: сексуальная привлекательность и покорность.

Имя Siri в переводе с норвежского означает «красивая женщина, которая ведет вас к победе». Cortana основана на «чувственной раздетой женщине» из видеоигры Halo. Даже Ava, виртуальный агент по поддержке клиентов, разработанный Autodesk, описывается как «двадцать с чем-то лет с гладкой кожей, пухлыми губами, длинными волосами и пронзительными коричневато-голубыми глазами…».

Возможно, эти черты характера сами по себе не являются проблематичными, и вы можете ожидать, что виртуальный помощник будет послушным персонажем. Однако, когда такие идеи столь последовательно и исключительно применяются для создания изображений женщин, это создает проблему.

Создатели этих женских персонажей быстро оправдывают себя от любой вины или негативных ассоциаций, поскольку они напоминают нам, что эти помощники технически бесполые.

Когда пользователь спрашивает Siri, является ли она женщиной, технология отвечает: «Я бесполый, как кактусы и некоторые виды рыб» или «У меня нет пола».

Помощник Google: «Я все вместе». И Cortana: «Ну, технически я - облако бесконечно малых вычислений данных». Только Алекса отвечает: «Я имею женский характер».

Почти все эти помощники были феминизированы - по имени, по голосу, по образцу речи и по личности. Онлайн-форумы приглашают людей поделиться изображениями и рисунками того, как эти помощники выглядят в их воображении. Почти все изображения изображают молодых привлекательных женщин.

Ответ на злоупотребление

Проблема тем более очевидна в невероятно неподходящих реакциях виртуальных помощников на жестокое обращение и преследование. Как вы можете видеть на графике здесь, средний голосовой ответ на эти высказывания - иногда бывает добрым, игривым и кокетливым. Хотя на первый взгляд они могут показаться безвредными, невозможно сказать, какие долгосрочные психологические эффекты могут оказать эти реакции на пользователей-мужчин.

(Не) слушать женщин

Поскольку виртуальные помощники в основном активируются голосом, слушание так же важно, как и ответ. Способность слышать и понимать, что именно хочет пользователь, является неотъемлемой частью основной функции устройства. К сожалению, виртуальные помощники также демонстрируют здесь сексистские тенденции, поскольку они гораздо реже слышат женщин-пользователей на постоянной основе.

Согласно исследованию, проведенному в Университете Вашингтона, широко используемое программное обеспечение Google для распознавания речи на 70 процентов более точно распознает мужскую речь, чем женскую.

Что питает этот сексизм?

Недостаточная представленность женщин особенно заметна во всей отрасли: от компьютерных работ, где женщины занимают только 1 из 4 должностей, до основателей стартапов в Силиконовой долине, из которых женщины составляют всего 12 процентов.

Как и следовало ожидать, искусственный интеллект следует примеру своих основателей. Согласно отчету ООН, только 12% исследователей ИИ и 6% разработчиков программного обеспечения ИИ - женщины.

Разработчики искусственного интеллекта в основном мужчины, обычно высокооплачиваемые и технически образованные. Их интересы, потребности и жизненный опыт обязательно будут отражены в ИИ, который они создают.

Почему это важно

Долгосрочные последствия значительные, особенно если учесть, что это может сделать для менталитета мужчин и женщин, которые регулярно их используют.

Чем больше культура учит людей приравнивать женщин к помощникам, тем более настоящие женщины будут рассматриваться как помощники.

Это простая концепция: вы относитесь к виртуальным «женщинам» определенным образом, и это поведение проявится в реальном мире с реальными женщинами. Вот почему рассмотрение последствий небольших технических решений так важно.

Как технические компании могут это исправить?

Будучи единственными контролерами своих виртуальных помощников, такие компании, как Google, Apple и Amazon, несут исключительную ответственность за решение проблемы гендерного ИИ, которая появилась на свет благодаря этому отчету ООН.

Петиция конца 2017 года, организованная социальной сетью Care2 и подписанная примерно 17 000 человек, в дополнение к Quartzstudy, помогла помочь Apple и Amazon помешать своим голосовым помощникам игриво реагировать на гендерные оскорбления. В петиции содержится призыв к технологическим компаниям "перепрограммировать своих ботов"

Есть более конкретные примеры решения проблемы, от бесполых голосов до проверок вежливости, но реальным решением будет сокращение гендерного разрыва в технологиях.

0 комментариев

Добавить комментарий